“太可怕了,视频、声音、口型完全看不出来真假。”日前,演员王劲松在社交平台发文怒斥,自己的形象被AI深度伪造,用于某公众号虚假理财推广。这一事件也迅速登上了热搜。

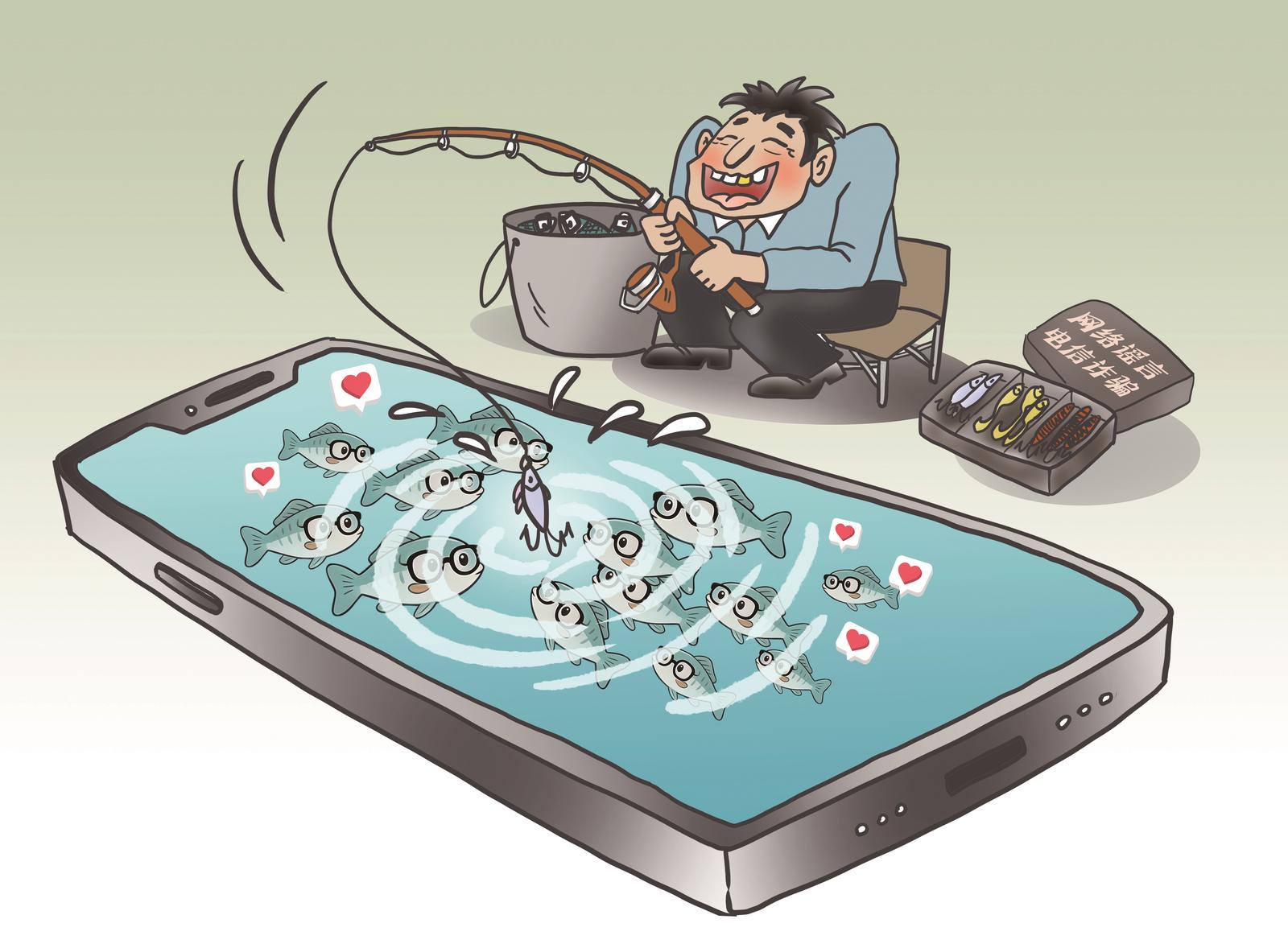

当下,人工智能(AI)技术正在以超出人们预想的速度普及,而当这项技术落入不法者手中,它便从便利工具变成了违法利器。从电信诈骗到网络造谣,从侵犯肖像权到深度伪造,AI的“另一面”正在引发诸多的法律问题和社会隐忧。

声音背后的陷阱:

当熟人的声音不再可信

日前,一起电信网络诈骗的受害人黄先生(化名)接到了一个陌生号码的来电。电话那头的声音让他瞬间放松了警惕,那是相识多年的香港朋友张先生的声音。对方说自己临时换了手机号,人在国外不方便,想请黄先生帮忙代购一款价值90万元的名牌手表,寄往广东某处,钱款稍后就会转过来。

黄先生没有多想,按照对方提供的地址将手表寄出。直到警方预警电话打来,他才得知那个声音并非来自朋友,而是一段被AI技术精准制作的合成语音。幸运的是,警方及时拦截了快递,90万元的损失被挽回。

黄先生的遭遇并非个案。警方在近期公布的多起案件中,梳理出了一种新型诈骗模式的完整图景。

这种诈骗的手法是:诈骗分子通过非法渠道获取目标对象的社交关系信息,然后利用AI声音合成技术,仅凭少量语音样本就能生成与目标对象亲友高度相似的声音模型。接下来,他们会以“换号了”“人在境外不方便”等理由拨打电话,请求受害人代为支付货款、垫付资金或寄送贵重物品。

黄先生遇到的是“代购名表”版本骗局,而受害人赵婆婆(化名)遭遇的则是专门针对老年人的骗局。赵婆婆家中座机响起,对方自称是她小儿子的朋友,说小儿子因酒驾撞人被抓,急需10万元现金“救急”。电话那头传来的“小儿子”的哭喊声,让老人颤抖着将2万元养老钱交给了上门取款的人。直到大儿子回家给弟弟打电话核实,才知道根本没有这回事。

技术的进步让诈骗分子有了更多可乘之机。过去,冒充熟人诈骗多依靠文字聊天或含糊其词的电话,受害人往往能从语气、用词习惯中察觉异样。如今,AI合成的声音和影像足以以假乱真,“眼见为实”“耳听为真”的传统经验正在失效。

对此,警方的建议简洁务实:接到自称亲友换号、要求代付转账的电话,务必通过当面确认、拨打原来的号码、发起视频通话等方式多重核实。AI可以模仿声音和面容,但无法复制你与亲友之间独有的互动细节和即时反应。遇到以“出事”“急需筹钱”为由制造恐慌的,先冷静下来,第一时间联系其他家人确认情况。记住一条原则:再急的事,也不差核实的那几分钟。

指尖上的谣言:

当AI成为造谣者手中的工具

如果说AI声音诈骗考验的是人与人之间的信任,那么AI造谣污染的则是整个信息生态。

合肥警方近日公布的三起典型案例颇具代表性。64岁的陈某为了获取网络平台的流量奖励,使用AI软件编辑配图,发布了一条“合肥市瑶海区长江批发市场火灾”的不实信息。53岁的刘某某在某短视频平台发布了“肥东高铁相撞”的AI生成视频,画面逼真,引发大量关注,扰乱公共秩序。20岁的江某某出于个人恩怨,多次使用AI工具合成恶搞形象视频,在网上对他人进行侮辱。

三个人共同的结局是:被警方依法予以行政处罚。接受处罚时,他们都表达了类似的懊悔“以为只是好玩”“没想到会这么严重”。

办案民警介绍,随着AI工具的普及,制造一则足以以假乱真的谣言,技术门槛已经降到了几乎为零。过去需要一定图片处理能力才能完成的“有图有真相”,现在只需在AI软件中输入一段描述文字,几秒钟就能生成配图甚至视频。这种便利带来的副作用是:谣言的产量、传播速度和危害程度都在同步上升。

法律对此并非没有准备。《中华人民共和国治安管理处罚法》规定,散布谣言故意扰乱公共秩序的,处五日以上十日以下拘留,可以并处五百元以下罚款。如果情节严重触犯刑法,则面临更严厉的惩罚。《中华人民共和国刑法》则设立了“编造、故意传播虚假信息罪”,编造虚假的险情、疫情、灾情、警情并在网络上传播,严重扰乱社会秩序的,处三年以下有期徒刑、拘役或者管制;造成严重后果的,处三年以上七年以下有期徒刑。

这意味着,那些在键盘前点击AI生成按钮的手指,可能正在将自己推向法律的审判席。“网络不是法外之地”这句话,正在被一次又一次的司法实践反复印证。

而对于普通网民而言,需要建立一种新的媒介素养:在AI可以批量生产“真实”的时代,对每一条耸人听闻的信息保持审慎,对每一张震撼的图片多想一下“会不会是AI生成的”,在转发之前多花几秒钟核实来源。抵制谣言,不仅是不造谣,也包括不信谣、不传谣。

AI侵权的灰色地带:

当面孔可以被“借用”

日前,演员王劲松在社交平台上的发声引发了广泛共鸣。他的形象被AI深度伪造用于虚假理财广告,而这种情况并非明星专属。随着各类AI工具的爆发式普及,普通人同样面临肖像被随意“借用”的风险——你发在朋友圈的一张自拍、上传到短视频平台的一段日常记录,都可能成为AI换脸的素材,被嫁接到带货广告、虚假宣传甚至违法内容中。

从法律角度看,AI侵权涉及多个层面的权利保护,首当其冲的是肖像权。《中华人民共和国民法典》规定,任何组织或者个人不得利用信息技术手段伪造等方式侵害他人的肖像权,未经肖像权人同意,不得制作、使用、公开肖像权人的肖像,法律另有规定的除外。这意味着,无论是将他人面部替换到影视作品中,还是用AI生成一个与他人类似的虚拟形象用于商业推广,只要具备可识别性且未经本人同意,并且不属于非营利性合理使用范畴,就将构成侵权。

更复杂的情况涉及名誉权和个人信息保护。如果AI伪造的形象将他人置于不雅、违法等不当场景中,导致其社会评价降低,则构成名誉权侵害。同时,AI换脸过程中涉及人脸等生物识别信息的采集和处理,根据《中华人民共和国个人信息保护法》,人脸信息属于敏感个人信息,处理此类信息需要取得个人的单独同意并履行明确告知义务,否则将承担相应法律责任。

此外,如果AI伪造使用的素材来源于受著作权保护的影视作品、摄影作品等,还可能同时触发著作权纠纷。据相关统计,全球范围内针对AI公司的版权侵权诉讼正在持续增长。

省律协知识产权专业委员会委员、上海中联(合肥)律师事务所高级合伙人李连连律师建议,一旦发现自己的合法权益被AI技术侵害,应迅速采取三个步骤:第一,通过区块链存证等方式全面固定证据,对侵权内容进行完整截图、录屏,确保能够展示侵权内容、发布者信息、发布时间和传播范围;第二,向发布平台投诉,要求立即删除侵权内容、屏蔽侵权账号,并留存投诉凭证;第三,如果平台处置不力或侵权情节严重,可委托专业律师启动法律程序,向行政机关投诉或向法院提起诉讼。

每一次技术革命都会带来新的法律和伦理挑战,技术本身没有善恶之分,关键在于使用技术的人。对于身处AI时代初期的我们而言,最可靠的防线或许不是更先进的检测工具,而是随着技术持续演进而不断完善的法律。当然,除了法律划定的红线,也需要每个技术使用者守住内心的底线。